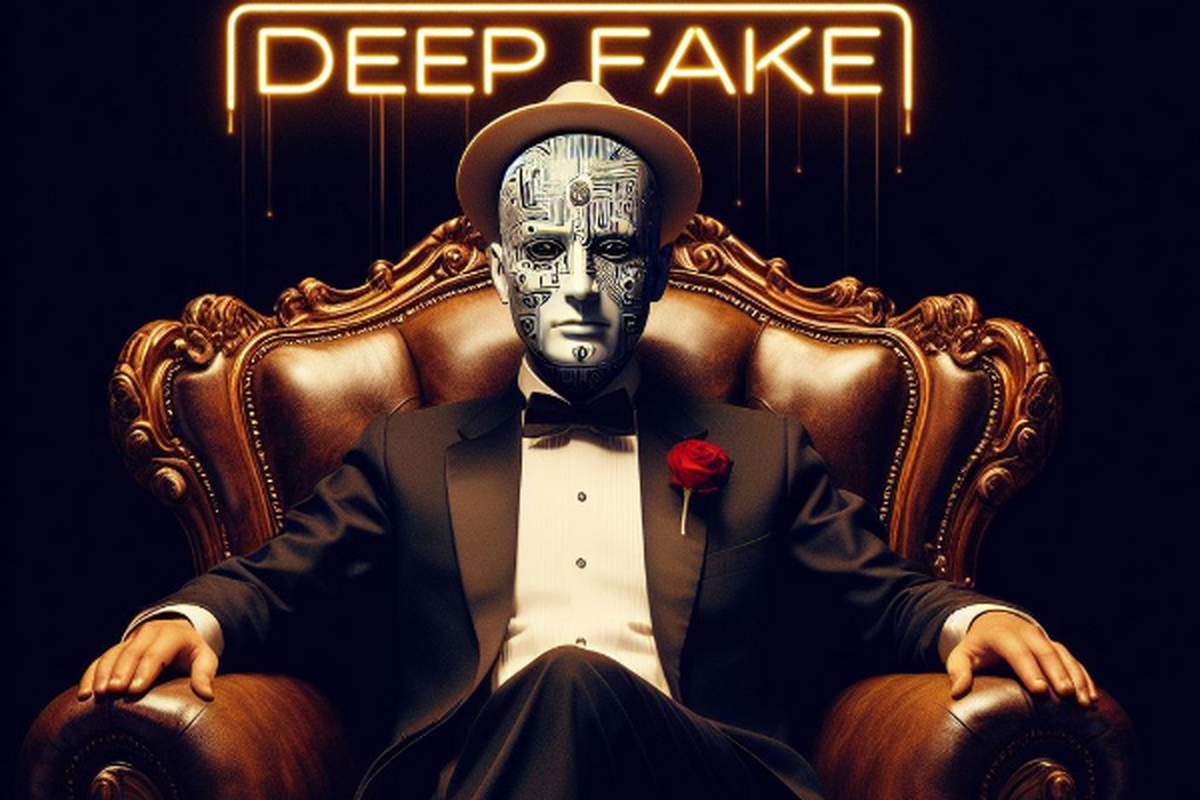

جعل عمیق «پدرخوانده هوش مصنوعی» است/ مقررات تشدید شود

به گزارش خبرگزاری علم و فناوری آنا به نقل از رویترز، کارشناسان هوش مصنوعی و مدیران صنایع با امضای نامهای سرگشاده خواستار مقررات بیشتر در مورد جعل عمیق (دیپ فیک) شده و خطرات احتمالی آن را در این نامه متذکر شدهاند.

این گروه از کارشناسان با همراهی اندرو کریچ (Andrew Critch)، متخصص هوش مصنوعی از دانشگاه برکلی در نامه سرگشاده خود نوشتند: «امروزه، در جعل عمیق اغلب از تصاویر جنسی، تقلبی یا اطلاعات نادرست سیاسی استفاده میشود و چون هوش مصنوعی بهسرعت در حال پیشرفت است ساخت جعل عمیق را بسیار آسانتر میکند.»

در این نامه با عنوان «زنجیره تأمین جعل عمیق را بر هم بزنید»، توصیههایی در مورد شیوه قانونگذاری برای جعل عمیق ارائه شده است، از جمله جرمانگاری تمام و کمال برای پورنوگرافی کودکانه با جعل عمیق و مجازات کیفری برای هر فردی که آگاهانه به ایجاد، تسهیل و گسترش محتواهای مخرب جعل عمیق کمک کند که شرکتهای هوش مصنوعی را نیز شامل میشود. استیون پینکر، استاد روانشناسی هاروارد، جوی بولاموینی، بنیانگذار لیگ عدالت الگوریتمی، دو رئیسجمهور سابق استونی و محققان گوگل در بخشهای دیپمایند و یک محقق از اُپنایآی از جمله امضاکنندگان این نامه هستند. تا لحظه انتشار این خبر، بیش از ۴۰۰ نفر در صنایع مختلف و حوزههای سرگرمی، سیاست و دانشگاه نامه را امضا کرده بودند.

تاکنون هشدارهای متعددی از سوی افراد برجسته درباره خطرات هوش مصنوعی مطرح شده است، بهویژه، نامهای که سال گذشته ایلان ماسک امضا کرد و توقف ششماهه توسعه سیستمهای قدرتمندتر از مدل جیپیتی ۴ اپنای آی را خواستار شد.

محتوای جعل عمیق شامل تصاویر، صداها و ویدئوهای واقعی و در عین حال ساختگیای هستند که توسط الگوریتمهای هوش مصنوعی ایجاد میشوند و پیشرفتهای اخیر در این فناوری باعث شده است که تشخیص آنها از موارد واقعی روزبهروز سختتر شود.

انتهای پیام/