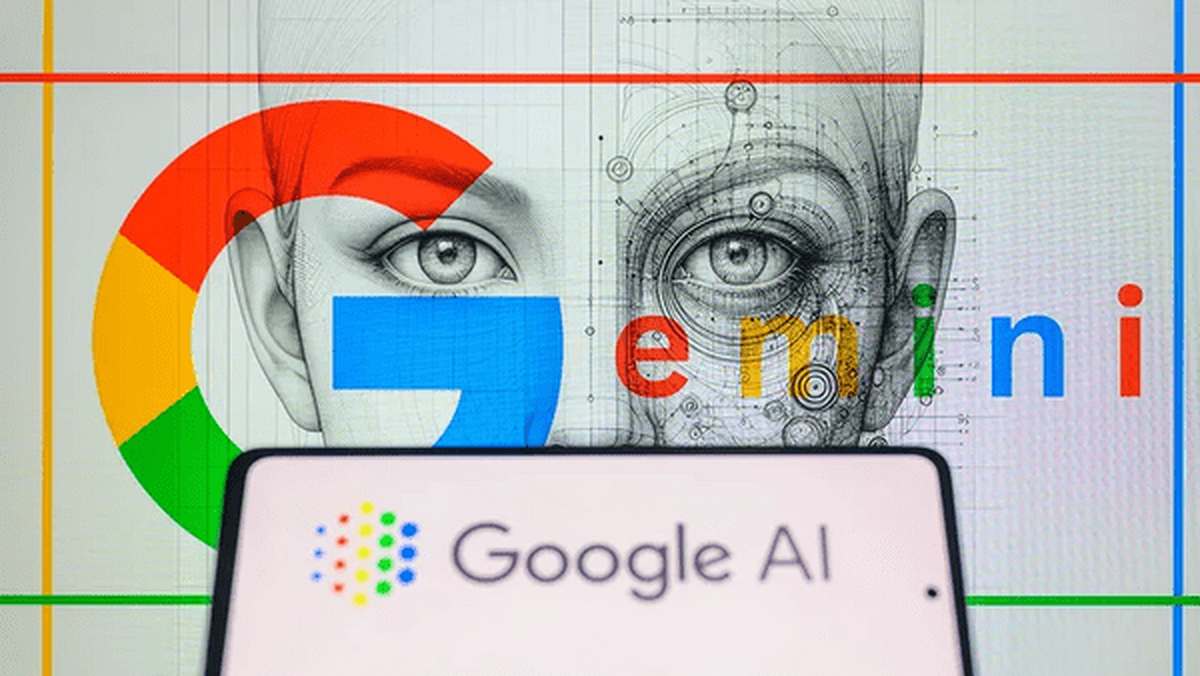

خطاهای مدل هوش مصنوعی «جمنای» پذیرفتنی نیست

به گزار ش خبرگزاری علم و فناوری آنا به نقل از رویترز، گوگل در بیانیهای جدید اعلام کرد که در حال برطرف کردن مشکل مدل هوش مصنوعی خود، جمنای، است که به تازگی کمپانی گوگل را در مظان اتهام سوگیری نژادی قرار داده است.

هفته گذشته جمنای با انتشار تصاویری از شخصیتهای تاریخی مانند آلمانهای نازی و وایکینگها در جنگ جهانی دوم و رنگینپوست کردن چهره آنها سبب خشم بسیاری از کاربران و واکنش گسترده آنها در شبکه اجتماعی اکس (توییتر سابق) شد و گوگل برای رسیدگی به این مشکل، نرمافزار جمنای را به حالت تعلیق درآورد.

ساندر پیچای (Sundar Pichai) مدیرعامل جمنای گفت: «خطاهای نرمافزار جمنای پذیرفتنی نیست» و در خصوص مشکل پیش آمده به کارمندان خود هشدار داد: برخی از تصاویر ساختهشده برای کاربران توهینآمیز بوده و آنها را به این فکر انداخته که این نرمافزار سوگیری داشته است. پیچای افزود: «تیمهای ما به صورت شبانهروزی برای رسیدگی به این مسائل کار میکنند. ما در حال حاضر دستور (پرامپت)ها را تا حد قابلتوجهی بهبود دادیم و آنچه اتفاق افتاده را بررسی میکنیم تا مطمئن شویم این مشکل به طور کامل برطرف شده است.»

گوگل قصد دارد در چند هفته آینده هوش مصنوعی جمنای را از حالت تعلیق دربیاورد و نسخه جدید را دوباره راهاندازی کند. این خبر را سخنگوی گوگل نیز تأیید کرده است.

از زمان راهاندازی چت جیپیتی اُپن ای آی به پشتیبانی مایکروسافت در نوامبر ۲۰۲۲ گوگل رقابت خود را با این نرمافزار و سایر نرمافزارهای هوش مصنوعی آغاز کرده است.

گوگل یک سال پیش چتربات هوش مصنوعی بارد را منتشر کرد و در اوایل ماه فوریه 2024 گوگل نام آن را به جمینای تغییر داد و برنامههای اشتراک پولی را ارائه کرد، که کاربران با خرید آن میتوانستند از مدل هوش مصنوعی برای استدلالهای بهتر استفاده کنند.

انتهای پیام/